毎月Rist主催で行われているAI勉強会。弊社インターン生にレポートを書いていただいています。実際にAIを勉強している彼らに独自の視点で書いてもらうことで、研究理解を深め、さらにRistとしてもパワーアップしていけたらと思います。感想も踏まえて書いていきますので、是非とも最後までお読みいただければと思います。

このたび勉強会のレポートを書かせていただくことになりました、11月からRistでインターンをしている尾上寛弥です。普段はアノテーションの作業をしたり、基本的な深層学習モデルの実装に取り組んでいます。5回目となるRist主催の勉強会ですが、今回初めて参加しました。どうぞよろしくお願いします。

今年最初となる今回の勉強会は2月10日(月)に行われました。これまでは毎月開催されていた勉強会ですが、今年からは交流会と勉強会を交互に開催することとなりました。会場は今月3日に完成したばかりの弊社7階オフィス。とても綺麗でお洒落な雰囲気の中での勉強会で、学生やエンジニア、研究者など非常にたくさんの方が参加してくださいました。

19:30より勉強会がスタート。最初に弊社広報の山田より本日の進行について、次に弊社代表の藤田より勉強会の趣旨や今後の展望について説明がありました。

1人目の発表はスペシャルゲストとしてご参加いただいた、日本デジタルゲーム学会理事の三宅陽一郎氏。テーマは「デジタルゲームと人工知能技術」についてです。今までの勉強会では大学の先生にお越しいただき、その研究内容を発表していただいていましたが、今回はかなり毛色の違った発表内容だったのではないでしょうか。

はじめに、メタAIやキャラクターAI、ナビゲーションAIといったゲーム内で使用されている様々な人工知能について、具体的なゲーム画面を例としながら解説していただきました。こういったAIは昔からありますが、最近の機械学習の発展によってより高度なものへと変化しているそうです。さらに、ゲーム内だけではなくゲーム開発においても、人工知能が活用されており、効率的なバグ発見に役立っているとのこと。ひとえにゲームAIといっても非常にたくさんの種類があり、実際に最新の有名ゲームで使われている事例からも、人工知能の汎用性の高さを感じました。また、そういったゲームの人工知能技術はゲームだけでなく、スマートシティや人間拡張にも活用できるそう。思わぬところで技術が活用できることには驚きでした!最後に質疑応答の中で三宅さんが、ゲームは現実ですぐには試せないAI技術の実験場になる、とおっしゃっていたのも印象深かったです。そうやって生まれた技術によって、これから色々なことが便利になっていくのが楽しみですね。

三宅さんの発表の後は交流会も兼ねた軽食タイムです。美味しそうな巻き寿司とオードブルが用意され、会場もとても盛り上がっている様子でした!私もご飯を片手に、他のインターン生や社会人の方とお話していたら、あっという間に時間が過ぎてしまいました。

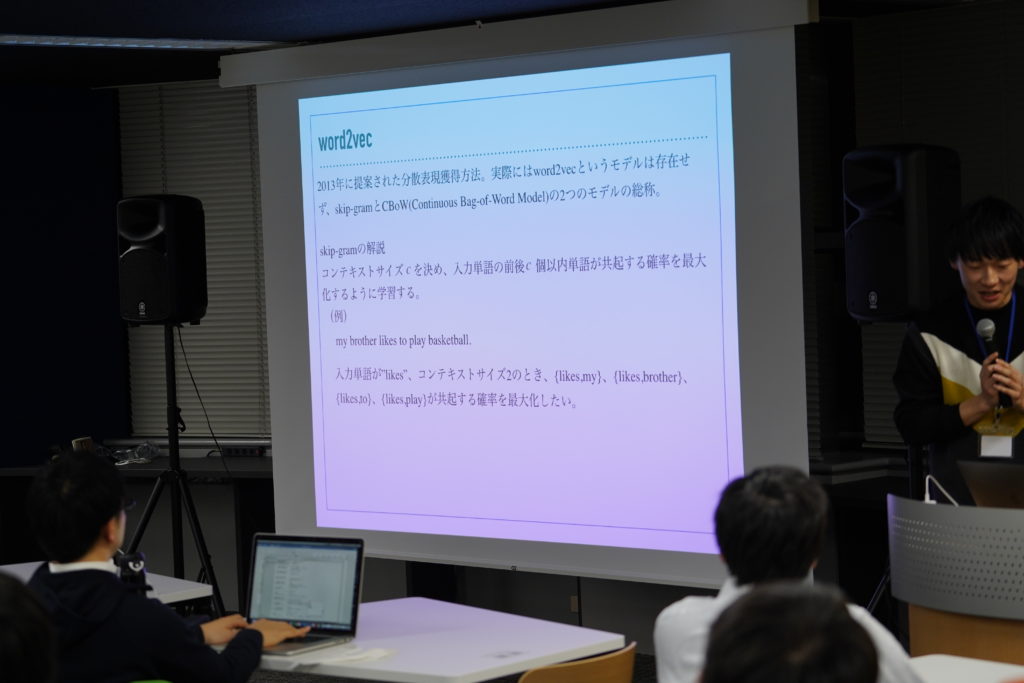

後半は弊社インターン生の2人による発表です。2人目の発表は劉天楚さんで、テーマは「自然言語処理における深層学習入門」です。

人間が作り出した記号である自然言語を、数学的に表現することは簡単ではありません。最初はその表現方法としてone-hotベクトルや分散表現ベクトル、word2vecについて紹介してもらいました。そこからはRNN, Seq2seq, Transformer, BERTの順に、自然言語処理での深層学習モデルの解説です。ごく基本的なモデルの解説から、徐々にそれを応用した新しいモデルを解説していく流れだったので、BERTのような最新の複雑なモデルの内容もすんなりと頭に入ってきました。最後に見せてくれたのは、自然言語処理の各モデルの性能を総合的に評価する、GLUEベンチマークの順位表です。その順位表には参考として人間が含まれているのですが、現在の順位は9位だそうです。既に人間を超えているモデルが8つもあることには驚きです。さらに半年前まで人間は1位だったそう!技術進歩の凄まじい速さを感じました。

今回の勉強会は、ゲームや自然言語処理のAI技術について基本から応用まで深く幅広く学べ、さらにAI技術が様々な分野で活用されていることを実感できる内容でした。私もこの勉強会で得た様々な貴重な学びをこれから積極的に生かしていきたいと思います。

次回の勉強会は4月24日に行われます。近日中に詳細はconnpassにて発表される予定です。今回参加された方も参加できなかった方もぜひご参加ください!